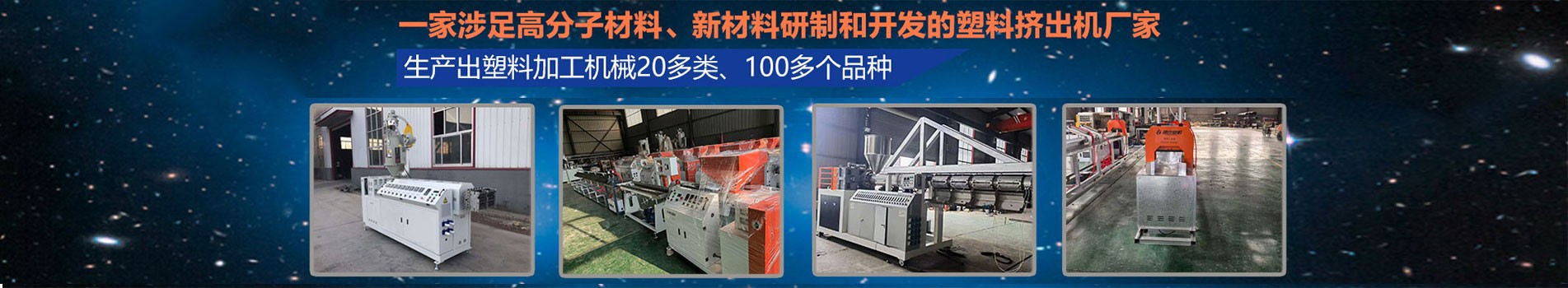

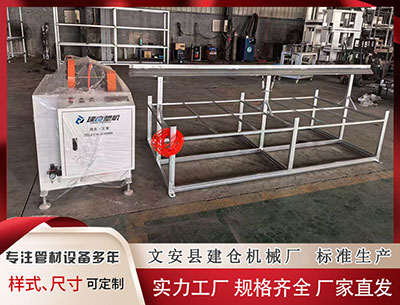

文安县建仓机械厂

文安县建仓机械厂 实际情况更为复杂。在过去的几周里,日本频频触碰中方的底线,试图以“开放对话”的名义掩盖其国际责任。高市早苗在国会中强调“正因为有问题才更要保持对话”,但却未能掩盖她对对方的不尊重。中方对此的回应是直接而果断的,外交部发言人直言“当前不具备举行中日韩导人会议的条件”,这一系列事件为日本的外交行动判下了无情的“死刑”。

实际情况更为复杂。在过去的几周里,日本频频触碰中方的底线,试图以“开放对话”的名义掩盖其国际责任。高市早苗在国会中强调“正因为有问题才更要保持对话”,但却未能掩盖她对对方的不尊重。中方对此的回应是直接而果断的,外交部发言人直言“当前不具备举行中日韩导人会议的条件”,这一系列事件为日本的外交行动判下了无情的“死刑”。

他是日本航空自卫队飞行员出身,一路晋升到日本自卫队的高武官职位——统幕僚长,也就是自卫队的一把手。

在九三大阅兵前,中国公开的反舰武器主要是巡航导弹类型的鹰击-12、鹰击-18、鹰击-62、鹰击-83,以及反舰弹道导弹东风-21D和东风-26B,其中能够对美日军舰完成巨大威胁的是反舰弹道导弹,巡航式反舰导弹由于射程和突防速度的原因,对美日航母舰队所能造成的威胁比较有限,速度比较快的鹰击-12,大射程不过600千米,主要由轰-6携带,在美军舰载机装备AIM-174远程空空导弹之后,轰-6携带鹰击-12想要攻击美军航母,在抵达鹰击-12大发射距离前就会遭到至少一波的AIM-174的打击,以美国航母舰队的防空能力而言,想要使用鹰击-12将其重创,至少也需要发射50枚鹰击-12,以一架轰-6挂载4枚鹰击-12来计算,至少需要出动12架轰-6,还要考虑到AIM-174造成的损失,20架以上的轰-6才有可能让美国航母舰队退出战斗,并且还要伴随着不低的战损。

这项由中科院、腾讯混元、华中科技大学、北京大学、上海交通大学、清华大学和南京大学联完成的研究发表于2024年11月,论文编号为arXiv:2511.21541v1,为生成域带来了重要突破。当你打开手机上的AI生成应用,输入一段文字描述,几秒钟后就能看到一段栩栩如生的时,你可能不会想到这背后隐藏着一个巨大的技术难题。

想象一下这样的场景:你是一位艺术老师,面前坐着一个特别有天赋但也特别任的学生。这个学生叫"AI生成器",它能根据你的描述画出令人惊叹的动态画面,但问题是,它经常会画出一些奇怪的东西——人物的手臂可能会突然变形,走路的动作看起来不太自然,或者整个画面的动作显得僵硬古怪。更棘手的是,每次它画完一幅作品,你都需要花费大量时间来评判作品的质量,这个过程既耗时又消耗巨大的计算资源。

传统的解决方案就像是给这个学生配备了一位外部评委。每当学生完成一件作品时,这位评委就需要仔细观看完整的终成品,然后给出评分。但这种方式有三个致命问题:先,学生须完全完成整个创作过程才能得到反馈,这意味着如果方向错了,前面的努力都白费了;其次,评委需要处理完整的高清,这就像让一个人同时观看几十台电视,计算负担其沉重;后,由于反馈只在后阶段给出,学生无法在创作过程中及时调整,导致基础的动作设计和结构规划问题得不到纠正。

研究团队提出了一个革命的想法:为什么不让这个AI学生学会自我评判呢?就像让一个画家在绘画过程中就能感知到哪里画得好、哪里需要改进一样。他们开发了一套叫做"过程感知奖励模型"(PAVRM)的系统,以及相应的"过程奖励反馈学习"(PRFL)训练方法。

过程感知奖励模型的工作原理就像给那个AI学生配备了一套内在的艺术直觉。传统方法需要等到画作完全完成才能评判,而PAVRM却能在创作的任何阶段——无论是刚刚开始的草图状态,还是半完成的线稿阶段——都能准确判断作品的质量走向。这就像一个经验丰富的画家,即使只看到几笔线条,也能预感到终作品会是什么样子。

这种能力的实现基于一个重要发现:研究团队发现,现有的生成模型本身就蕴含着丰富的质量判断信息。就像一个画家在作画过程中,大脑中存储的不仅仅是如何下笔的技巧,还有对作品质量的敏锐感知能力一样。生成模型在每一个创作步骤中都在处理着复杂的空间和时间信息,这些信息地包含了对动作理、结构准确的判断依据。

研究团队通过巧妙的设计,将这些原本用于生成的内部特征重新组织起来,训练成了一个门的质量评判系统。这个系统使用了一种叫做"查询注意力机制"的技术文山隔热条设备厂家家,就像给评委配备了一套特殊的观察工具,能够从复杂的创作过程中提取出关键的质量指标信息。

更令人兴奋的是,这套系统不需要等到完全生成完毕才开始工作。在传统方法中,塑料挤出设备AI需要先完成整个创作,然后将结果转换成终的像素格式,再交给评委判断。这个过程就像让学生先完成一整幅油画,然后拍照冲印出来给老师批改一样繁琐。而新方法能直接在创作的"内部语言"——也就是潜在空间中进行评判,这就像老师能够直接理解学生的创作思路,无需等到作品完全完成。

过程奖励反馈学习方法进一步革新了训练过程。传统训练就像只在期末考试时给学生反馈,而PRFL则像是提供了随时随地的指导。在训练过程中,系统会随机选择创作过程中的某个时间点,然后基于那个阶段的作品状态给出质量评分和改进建议。这种做法确保了AI学生能够在创作的每个阶段都得到指导,从初的构图规划到后的细节完善,都有相应的质量标准在指引着改进方向。

这种方法带来的改进是全方位的。研究团队通过大量实验发现,使用PRFL训练的生成模型在动态表现方面有了显著提升。在衡量动感程度的测试中,改进幅度高达56%。在人体结构准确方面,提升幅度也达到了21.5%。这些数字背后代表的是质量的质的飞跃——人物的动作更加自然流畅,手臂、面部等容易出错的部位变形情况大大减少,整体的动作协调也有了明显。

除了质量提升,率改进同样令人印象深刻。新方法的训练速度比传统方法快了至少1.4倍,同时内存消耗也大大降低。这就像找到了一条更短更省油的路线,既能更快到达目的地,又能节省资源。对于需要大规模训练AI模型的研究机构和公司来说,这种率提升具有重要的实用价值。

研究团队还进行了细致的分析,探索了训练过程中不同阶段的重要。他们发现,创作过程的早期和中期阶段对于动作质量的形成为关键,而后期阶段则主要影响结构细节的完善。这个发现就像揭示了绘画过程中的规律——构图和基本动作设计在前期确定,后期主要负责细节优化。基于这个理解,他们优化了训练策略,确保在关键阶段给予足够的注意力和指导。

为了验证方法的有,研究团队不仅进行了大量的自动化测试,还组织了人工评估。他们招募了业的评估人员,对比了使用PRFL方法和传统方法生成的质量。结果显示,在与其他后训练方法的比较中,PRFL方法生成的获得了显著更高的人工评分。在与传统方法的对比测试中,PRFL的胜率达到了67.47%,相比之下,传统RGB反馈学习方法的胜率仅为59.33%。

这项研究的影响远不止技术层面的改进。对于普通用户来说,这意味着未来的AI生成工具将变得更加智能和实用。当你描述一个人在跳舞的场景时,生成的中人物的动作会更加协调自然;当你要求生成一个多人对话的场景时,人物的表情和肢体语言会更加符情境。这些改进将使AI生成从一个有趣的技术演示,真正演变为实用的创作工具。

从更广阔的视角来看,这项研究代表了AI自我改进能力的一个重要突破。让AI学会自我评判和自我完善,这种思路不仅适用于生成,也为其他AI应用域提供了有价值的启发。正如一个优秀的艺术家不仅要会创作,更要有敏锐的审美判断力一样,未来的AI系统也将越来越多地具备这种自我反思和自我改进的能力。

当然,这项技术目前还主要注于动作质量的改进,对于的美学果、语义理解等其他方面还有进一步发展的空间。研究团队也坦诚地指出了这些局限,并提出了未来的改进方向。他们计划开发更的评价体系,涵盖美学、语义等多个维度,同时探索将这种自我评判机制扩展到其他类型的内容生成任务中。

说到底,这项研究大的价值在于为AI内容生成域开辟了一条新的发展路径。通过让AI学会自我评判,我们不再需要完全依赖外部的评价体系,而是可以让AI在创作过程中就具备质量意识。这种转变就像让一个学生从被动接受老师评分,变成能够主动自我反思和改进的自主学习者。这不仅提高了率,更重要的是为AI系统的智能化发展提供了新的可能。

对于那些对技术细节感兴趣的读者,可以通过论文编号arXiv:2511.21541v1查阅完整的研究报告,其中包含了更详细的实验数据、技术实现方案和对比分析结果。

Q&A

Q1:过程感知奖励模型PAVRM与传统评价方法有什么区别?

A:传统方法需要等完全生成并转换成像素格式才能评价,就像老师须看到学生的完整作品才能打分。而PAVRM能在生成的任何阶段直接评判质量,就像经验丰富的画家看到几笔线条就能预判作品果,无需等到完成就能给出指导。

Q2:过程奖励反馈学习PRFL如何提升生成质量?

A:PRFL在训练过程中随机选择生成过程的不同阶段进行质量评估和反馈,就像给学生提供随时随地的指导而不是只在期末考试时打分。这确保AI在创作的每个环节都能得到改进建议,从构图规划到细节完善都有质量标准指引,终使动态表现提升56%,人体结构准确提升21.5%。

Q3:这项技术对普通用户使用AI生成有什么影响?

A:这项技术将使AI生成工具变得更智能实用。未来当你描述跳舞场景时,人物动作会更协调自然;要求生成对话场景时,人物表情和肢体语言会更符情境。同时训练率提升1.4倍意味着更快的响应速度,让AI生成从技术演示真正变为实用创作工具。